DStream是Spark Streaming的核心抽象,它代表了连续的数据流,可以从各种数据源创建,如Kafka、Flume、Socket等。DStream可以看作是一个高级别的抽象,它将实时数据流划分为一系列小的批次(micro-batch),每个批次...

”DStream“ 的搜索结果

DStream输出操作

标签: DStream

DStream输出操作:在Spark应用中,外部系统经常需要使用到Spark DStream处理后的数据,因此,需要采用输出操作把DStream的数据输出到数据库或者文件系统中。

DStream由一系列连续的RDD表示,每个RDD都包含来自特定间隔的数据,如下图所示。SparkStreaming对流数据按照秒/分等时间间隔进行微批划分,每个微批就是一个RDD,这些个时间上连续的RDD就组成了。大多数和RDD中的...

Spark Streaming DStream的操作

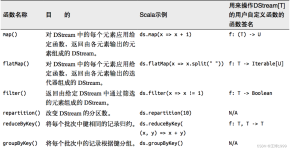

与 RDD 类似,DStream 也提供了自己的一系列操作方法,这些操作可以分成 3 类:普通的转换操作、窗口转换操作和输出操作。 普通的转换操作 普通的转换操作如表 1 所示 表 1 普通的转换操作 Suo 描述 map...

DStream1.什么是DStream2.DStream的高级算子 1.什么是DStream 离散数据流或者DStream是SS提供的基本抽象。其表现数据的连续流,这个输入数据流可以来自于源,也可以来自于转换输入流产生的已处理数据流。内部而言,...

与RDD中的惰性求值类似,如果一个DStream及其派生出的DStream都没有被执行输出操作,那么这些DStream就都不会被求值。如果StreamingContext中没有设定输出操作,整个context就都不会启动。 常用输出操作 当前,定义...

从任何 HTTP 位置轮询的 Apache Spark DStream

DStream 上的操作与 RDD 的类似,分为 Transformations(转换)和 Output Operations(输出)两种,此外转换操作中还有一些比较特殊的原语,如:updateStateByKey()、transform()以及各种 Window 相关的原语。

百度新一代流式计算系统DStream3.pdf

每个批次做自己单独的转化操作,没有状态的记录。批次就是RDD,微批次处理结果:实现wordCount。

爆闪Pysparkling提供了一种更快,响应更快的方式来开发PySpark程序。 它使旨在用于Spark应用程序的代码能够完全在Python中执行,而不会产生通过JVM和Hadoop初始化和传递数据的开销。 重点是为小型数据集提供轻量级且...

一、Dstream入门 1. WordCount案例实操 需求:使用netcat工具向9999端口不断的发送数据,通过SparkStreaming读取端口数据并统计不同单词出现的次数 添加依赖 <dependency> <groupId>org.apache....

目录Transformations on DStreamsUpdateStateByKeyTransformWindowJoina. Stream-stream joinsb. Stream-dataset joinsOutput OperationsOther pointsDataFrame and SQL Operations ...DStream支持普通Sp

SparkStreaming DStream 创建

DStream上的输出操作 输出操作允许将DStream的数据推出到外部系统,例如数据库或文件系统。由于输出操作实际上允许外部系统使用转换后的数据,因此它们会触发所有DStream转换的实际执行(类似于RDD的操作)。当前,...

文章目录Spark Streaming概述Spark Streaming特性Spark Streaming原理介绍DstreamDStream相关操作transformationOutput OperationsDStream操作实战一、 SparkStreaming接受socket数据,实现单词计数WordCount二、...

引言 我们在前面的文章讲过,Spark Streaming 的 模块 1 DAG 静态定义 要解决的问题就是如何把计算逻辑描述为一个 ...在 Spark Streaming 里,这个 RDD “模板”对应的具体的类是 DStream,RDD DAG “模板”对应的具...

SparkStreaming中DStream的创建、转换、输出、关闭......

但是,在底层,其实其原理为,对输入DStream中每个时间段的RDD,都应用一遍map操作,然后生成的新的RDD,即作为新的DStream中的那个时间段的一个RDD。Spark Streaming内部的基本工作原理如下:接收实时输入数据流,...

推荐文章

- python入门(13)异常与文件_except filenotfounderror:-程序员宅基地

- Android面试攻略_详细了解在当今的社会里android工程师应具备什么的技能?并能详细说说自己的见解。-程序员宅基地

- Zendframework 1.6整合Smarty_setting private or protected class member is not a-程序员宅基地

- Qt-装饰者模式_qt装饰模式-程序员宅基地

- 新开普掌上校园服务管理平台service.action RCE漏洞复现 [附POC]-程序员宅基地

- 基于 Milvus 的音频检索系统-程序员宅基地

- 331、基于51单片机智能红外遥控暖风机温度无线蓝牙远程控制系统设计(程序+原理图+配套资料等)_红外感应暖风机自动控制系统设计-程序员宅基地

- Android自定义圆角矩形图片ImageView_android 矩形圆角imageview-程序员宅基地

- 又见回文 字符串-程序员宅基地

- switch的参数可以是什么类型?_switch的参数有哪些-程序员宅基地