MNN 实现NV12转BGR

”MNN“ 的搜索结果

随着移动端应用的广泛普及和深度学习技术的不断发展,如何提升移动端深度学习的推断速度和准确性...本文将对MNN进行详细的介绍,并介绍如何安装和编译MNN,最后探讨一下MNN的优缺点和适用场景,以及未来的发展趋势。

MNN介绍、安装和编译

标签: mnn

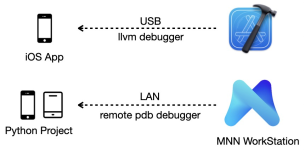

MNN(Mobile Neural Network)是由阿里巴巴开发的用于移动端的轻量级神经网络推理引擎。它支持多种硬件平台(包括 ARM CPU、ARM GPU 和 DSP)以及多种操作系统(包括 Android 和 iOS)。MNN 的设计目标是高性能、低...

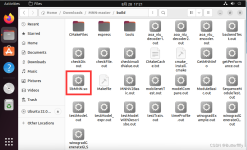

ubuntu下MNN环境搭建

这里代码其实大部分来自于xiongdongzhang的github项目:https://github.com/xindongzhang/MNN-APPLICATIONS,个人觉得学习一个新东西,最开始的步骤应该是用起来,至于怎么用起来,可以先参考一下别人怎么用的,将...

MNN是一个轻量级的深度学习推理框架,由阿里巴巴公司开发。它支持多种硬件平台,包括CPU、GPU和NPU,并提供高效、高性能的深度学习模型推理服务。以上是MNN的安装和编译步骤的一般流程。具体的步骤和注意事项可能因...

而Protobuf,作为Google开发的高效结构化数据存储格式,更是为MNN的模型文件序列化和反序列化提供了强有力的支持。在深度学习中,模型文件的序列化和反序列化是不可或缺的一环。而MNN和Protobuf作为深度学习领域的...

欢迎大家体验并点star~

MNN(Mobile Neural Network)是一个高性能、通用的深度学习框架,支持在移动端、PC端、服务端、嵌入式等各种设备上高效运行。MNN利用设备的GPU能力,全面充分“榨干”...

MNN详细介绍、安装和编译

标签: mnn

深入探讨了MNN(Mobile Neural Network)的介绍、安装和编译过程,以及使用指南、优化技巧和实际应用场景。

专为在设备端进行深度学习模型的加载和推理预测而设计。MNN(Mobile Neural Network)是一个。

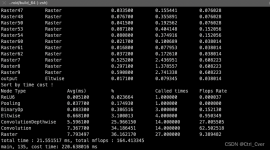

MNN初探MNN介绍开始编译Benchmark工具参考 MNN介绍 MNN(mobile Neural Network)是一个轻量级的深度神经网络推理引擎,在端侧加载深度神经网络模型进行推理预测。针对端侧设备特点深度定制和裁剪,无任何依赖,可以...

来说,主要有 VulkanBasicExecutionDirect 和 VulkanBasicExecutionInDirect,我们以。调用是个多态,其基类为。函数是个虚函数,对于。函数是个虚函数,对于。

pytorch自身部署较麻烦,一般使用onnx和mnn较为实用 训练模型的代码: import torch import torch.nn as nn import torchvision import torchvision.transforms as transforms import torch.optim as optim from ...

mnn | mnn安装教程

MNN,作为一个轻量级、高效率的深度学习框架,近年来受到了众多开发者和研究人员的青睐。本篇博客将深入探讨MNN的核心特性、安装过程以及如何编译,帮助开发者更好地理解和使用这一强大的工具。通过上述介绍和指南,...

pytorch训练的模型在实际使用时往往需要转换成onnx或mnn部署,训练好的模型需先转成onnx: import sys import argparse import torch import torchvision import torch.onnx from mobilenetv2 import MobileNetV2...

cd MNN/ ./schema/generate.sh mkdir build cd build cmake .. -DMNN_BUILD_CONVERTER=true && make -j4 二、转换命令 进入build目录,可以看到刚才编译出的可执行文件MNNConvert。 tensorflow: ./...

mnn c++ 图像处理 多通道 时序输入 多帧输入

初探MNN 伴随着大量人工智能项目的落地,业界对端上推理的需求也越来越旺盛。在之前的文章中介绍过OpenCV的DNN模块,目前开源的端上推理引擎除了OpenCV的DNN之外,还有tensorFlow-lite、paddle-lite、NCNN、MNN等多...

去年写过一篇博客,当时通过自己写conanfile.py,实现了对第三方库cpp_redis的conan封装。当时使用的conan 1.45.0时过一年多,conan版本也经过了很多次升级,最新的版本是2.x,不过为了保持兼容现在我使用的版本是...

【MNN学习一】基于Linux的MNN编译安装,模型转换以及benchmark测试 @Vivia 2019-09-28 14:36:40 2277 收藏 6 展开 目录 一. MNN编译安装 (MNN编译) 二. 编译模型转换工具MNNConvert (MNNConvert) 三. 下载模型并...

1.linux上编译安装mnn;2.onnx模型转mnn模型

今天MNN更新了新的工具包---CNN网络量化工具(quantization),作者也第一时间进行了测试。提升的效果还是很可观的,量化前的CNN网络大小约为5.7M,在rk3399(android-8.1)的inference速度约为45ms。使用MNN提供的...

本文使用JNI技术在Android平台部署深度学习模型,并使用MNN框架进行模型推理。 模型及C++程序准备 mnist-mnn Android环境配置 打开Android studio, 创建一个Native C++工程,并配置OpenCV。 在Android中使用...

推荐文章

- yolov3系列(四)-keras-yolo3-实时眼睛鼻子嘴巴监测系统_眼睛 嘴巴 yolo-程序员宅基地

- C++类型支持之std::decltype-程序员宅基地

- GB/T28181国标视频监控平台TINYGBS支持4G执法记录仪接入大型可视指挥调度平台-程序员宅基地

- 毕设项目 基于wifi的室内定位算法设计与实现-程序员宅基地

- 【.Net】C# 根据绝对路径获取 带后缀文件名、后缀名、文件名、不带文件名的文件路径...-程序员宅基地

- c语言比用delay更好的延时,PIC单片机C语言程序设计(15)-程序员宅基地

- 微型计算机的细思维特征,详细版2014计算机基础期末考试大纲-程序员宅基地

- org.eclipse.wst.common.component_org/eclipse/wst/common/componentcore/resources/ivi-程序员宅基地

- 数据结构乐智教学百度云_数据结构 百度网盘分享-程序员宅基地

- Arcade 绘制全屏-程序员宅基地