”attention“ 的搜索结果

@inproceedings{wiegreffe-pinter-2019-attention, title = "Attention is not not Explanation", author = "Wiegreffe, Sarah and Pinter, Yuval", booktitle = "Proceedings of the 2019 Conference on ...

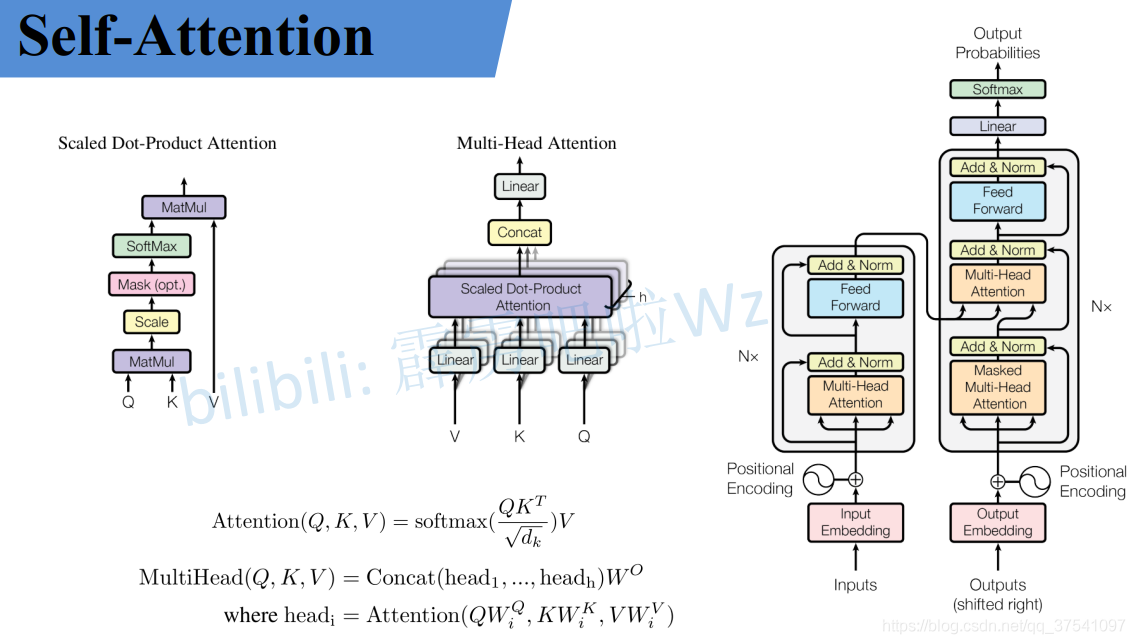

Attention是Transformer的核心部分,Attention机制帮助模型进行信息筛选,通过Q,K,V,对信息进行加工。

为什么需要Attention2. Attention的基本原理3. Attention存在的问题总结 1. 为什么需要Attention 在了解Attention之前,首先应该了解为什么我们需要注意力机制。我们以传统的机器翻译为例子来说明为什么我们需要...

cnn+lstm+attention对时序数据进行预测 博客链接: https://blog.csdn.net/qq_30803353/article/details/121875376 1、摘要 本文主要讲解:bilstm-cnn-attention对时序数据进行预测 主要思路: 对时序数据进行分块,...

1.由来 在Transformer之前,做翻译的时候,一般用基于RNN的...输入的x1,x2x_{1},x_{2}x1,x2,共同经过Self-attention机制后,在Self-attention中实现了信息的交互,分别得到了z1,z2z_{1},z_{2}z1,z2,将z1,z2

该模式的计算复杂度为,与输入序列长度线性相关,通常情况下。此外,作者通过对 query和 key 矩阵进行归一化来限制其幅度,使得归一化矩阵和的每一列为长度是的单位向量,并使得维的交叉协方差矩阵中的每个元素都在...

直接替换Excel数据即可用,注释清晰,适合新手小白,图片excel文件标有特征预测列。[3]注意力机制:为模型提供了对关键信息的聚焦能力,从而提高预测的准确度。[2]长短期记忆网络 (LSTM):处理数据捕捉长期依赖关系...

点击上方,选择星标或置顶,每天给你送干货!阅读大概需要12分钟跟随小博主,每天进步一丢丢来自 AI部落联盟导读注意力模型在大部分的自然语言处理任务中都得到了广泛应用,而且取得很不错的效果...

Attention的原理和实现 目标 知道Attention的作用 知道Attention的实现机制 能够使用代码完成Attention代码的编写 1. Attention的介绍 在普通的RNN结构中,Encoder需要把一个句子转化为一个向量,然后在Decoder中...

Attention-BiLSTM模型结构及所有核心代码: 1.model中实验的模型有BiLSTM、ATT-BiLSTM、CNN-BiLSTM模型; Attention与BiLSTM模型首先Attention机制增强上下文语义信息,并获取更深层次特征,最后通过Softmax进行回归...

直接替换Excel数据即可用,注释清晰,适合新手小白,图片excel文件标有特征预测列。[1]卷积神经网络 (CNN):捕捉数据中的局部模式和特征。[2]长短期记忆网络 (GRU):处理数据捕捉长期依赖关系。...

预测结果指标: | 8531.228661946116 | 92.36465049977787 | 69.83328143269027 | 2.2476557802459136% | 99.78584229212257% || 测试集指标 | MSE | RMSE | MAE | MAPE | R2 |整理了CNN-LSTM-Attention的回归预测...

Attention 正在被越来越广泛的得到应用。尤其是 BERT 火爆了之后。 Attention 到底有什么特别之处?他的原理和本质是什么?Attention都有哪些类型?本文将详细讲解Attention的方方面面。 Attention 的本质是...

Attention Is All You Need

为了更准确地提取文本特征并提高化工事故分类的准确性,该文提出了一种基于Attention机制的双向LSTM (BLSTM-Attention)神经网络模型对化工新闻文本进行特征提取并实现文本分类.BLSTM-Attention神经网络模型能够...

【24年】NRBO-CNN-LSTM-Attention多变量回归预测,基于牛顿-拉夫逊优化算法(NRBO)优化卷积神经网络(CNN)-长短期记忆神经网络(LSTM)-注意力机制(Attention)的多变量回归预测(可更换为分类/时许预测,具体私聊),...

直接替换Excel数据即可用,注释清晰,适合新手小白,图片excel文件标有特征预测列。[3]注意力机制:为模型提供了对关键信息的聚焦能力,从而提高预测的准确度。[2]长短期记忆网络 (BiLSTM):处理数据捕捉长期依赖...

基于attention文本分类代码基于attention文本分类代码基于attention文本分类代码

自关注与文本分类 本仓库基于自关注机制实现文本分类。...$ python imdb_attention.py 比较结果 算法 训练时间(每纪元) Val准确率 Val损失 所需Epoch数 LSTM 116秒 0.8339 0.3815 2 双向LSTM

transformer的改进:

探索未来视觉:《Visual Attention Network VAN》分类项目解析 项目地址:https://gitcode.com/Visual-Attention-Network/VAN-Classification 在深度学习领域,计算机视觉是一个重要且活跃的研究方向。其中,注意力...

各种Unet模型用于图像分割的实现-Unet,RCNN-Unet,注意力Unet,RCNN-Attention Unet,嵌套式Unet细分Unet细分-Pytorch-Nest-of-Unets各种Unet模型用于图像分割的实现UNet- U-Net:用于生物医学图像分割的卷积网络...

安装$ pip install local-attention用法 import torchfrom local_attention import LocalAttentionq = torch . randn ( 8 , 2048 , 64 )k = torch . randn ( 8 , 2048 , 64 )v = torch . randn ( 8 , 2048 , 64 )...

基于torch实现cnn+lstm+attention 模型时间序列预测代码模板 通用

ResNet_Attention(CBAM,SE) 官方说明: , 所需环境Ubuntu20.04 GTX 1080Ti Python3.7 PyTorch 1.7.0 CUDA10.2 CuDNN7.0使用方法(带有CIFAR10的trian) 该模型的主干是ResNet。 在我们的培训中,我们使用CIFAR10...

推荐文章

- 航空航天数值分析matlab算法,数值分析 matlab-程序员宅基地

- Zookeeper权限管理与Quota管理_zookeeper ip 和quota ip-程序员宅基地

- ocr数据集:图片数据集_ocr 图片集-程序员宅基地

- python识图自动化_聊聊 Python 自动化截图的一些经验-程序员宅基地

- python语言的关键字是什么_Python语言的关键字有哪些特点?关键字列举-程序员宅基地

- pandas数据处理之groupby的常用用法_pandas怎么处理groupby的结果-程序员宅基地

- 第一次参赛获Java B组国二,给蓝桥杯Beginners的6700字保姆级经验分享。_蓝桥杯java组经验贴-程序员宅基地

- 二叉链表——构建与输出_构建一个用二叉链表存储一个公司组织机构的相关数据的程序,假设该公司的下属-程序员宅基地

- 详解支持向量机(SVM)算法与代码实现_3. 软间隔和核svm分别实现一个识别task。代码-程序员宅基地

- C#使用TreeView控件实现的二叉树泛型节点类 BinaryTreeNode<T>泛型二叉树类BinaryTree<T>及其方法_c# treeview 树状节点-程序员宅基地