1.编写目的:由于cdh-5.9.2自带spark版本是spark1.6,现需要测试spark2新特性,需要整合spark2, 且spark1.x和spark2.x可以同时存在于cdh中,无需先删除spark1.x; 2.安装包下载 2.1首先下载csd包,地址: ...

”cdh-spark2“ 的搜索结果

一.安装准备 csd包:http://archive.cloudera.com/spark2/csd/ parcel包:http://archive.cloudera.com/spark2/parcels/2.3.0.cloudera2/ ...2.下面的操作,只需要在安装spark2的机器上面进行,我只选择C...

内容概要:由于cdh6.3.2的spark版本为2.4.0,并且spark-sql被阉割,现基于cdh6.3.2,scala2.12.0,java1.8,maven3.6.3,,对spark-3.2.2源码进行编译 应用:该资源可用于cdh6.3.2集群配置spark客户端,用于spark-sql

CDH-spark源码编译说明文档.doc

大数据组件,官方版本:CDH5.9.0 操作系统:CentOS7/RHEL7 完整系列: CDH-5.9.0-1.cdh5.9.0.p0.23-el7.parcel(该文件被分割成三个压缩包,例如:.aa/.ab.ac) CDH-5.9.0-1.cdh5.9.0.p0.23-el7.parcel.sha 由于 ...

HBaseContext所需要的jar包。由于不知道为啥maven配置仓库地址不生效。所以手动下载了个。导入本地环境的maven仓库。

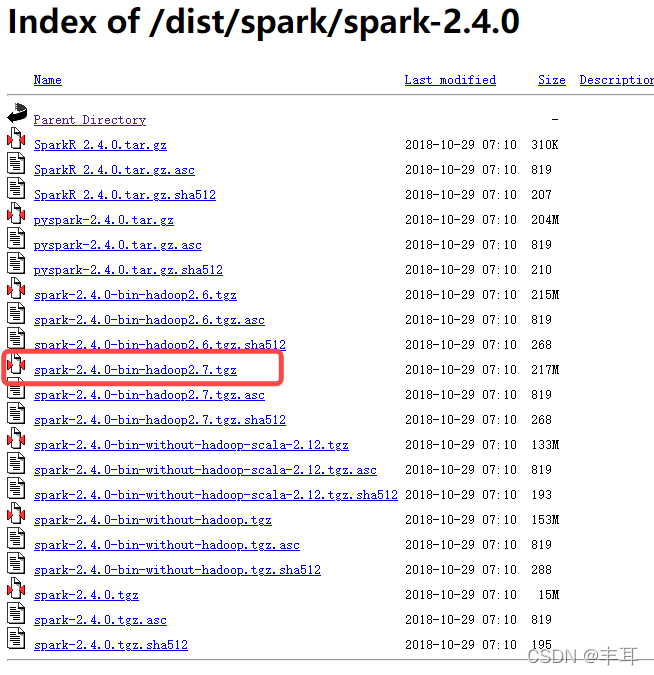

详细的文档在系列cdh搭建第一篇有详细的介绍,但是相关场景,觉得还是需在本篇做一下补充。...spark2自定义安装 参考这篇文章 https://blog.csdn.net/Gavin_chun/article/details/78554277 一、下载 ...

针对cdh6.2.0编译的apache-kylin-4.0.1版本: scala:2.11.12 spark:2.4.7 hadoop:3.0.0 hive:2.1.1 cdh:3.0.0-cdh6.2.0

carbondata-1.4,spark-2.1,hadoop-2.6.0-cdh5.11.1源码编译

会议 JUC 会议准备 EDIT TEST Docker 与 CDH 5.4 和 Oracle 用于 JUC 会议 $ docker build -t landoop/cloudera-5-latest-with-oracle $ docker run -t -i landoop/cloudera-5-latest-with-oracle

spark-sql_2.11-2.4.0-cdh6.1.1.jar

cdh-hive2.1.1版本orc文件读取数据报错替换包: Caused by: java.lang.ArrayIndexOutOfBoundsException: 7 at org.apache.orc.OrcFile$WriterVersion.from(OrcFile.java:145) at org.apache.orc.impl.OrcTail....

自编译spark3适配CDH6.3.2

带编译所需的maven库,spark2.3.3源码基于hadoop2.6.0-cdh-5.15.2进行重新编译

spark 3.3.1 使用 cdh 6.3.2 的hadoop版本。可以直接兼容并配合文档进行cdh spark-sql的使用。 具体查看https://editor.csdn.net/md/?articleId=127997188

spark-1.6.0-cdh5.12.0 centOS6.5 hadoop-2.6.0-cdh5.12.0 jdk1.8.0_144 scala2.12.3 服务器规划 HostName ServerIP Remark node1.sunny.cn 192.168.2.11 Master、Slave node2.sunny.cn ....

CDH-6.3.2详细安装教程,从零到一的详细教程,包括mysql、Java、CM、hive、Spark、Hadoop、zookeeper、kafka、Hue、flume、oozie的安装教程

目的刚入门spark,安装的是CDH的版本,版本号spark-core_2.11-2.4.0-cdh6.2.1,部署了cdh客户端(非集群节点),本文主要以spark-shell为例子,对在cdh客户端上提交spark作业原理进行简单分析,加深理解spark-shell...

CDH内嵌Spark版本不支持spark-sql,因为cloudera在推自己的impala,但是有些场景需要用到Spark-sql时,比如Kylin企业版想要加快构建需要用到SparkSQL,大概的思路就是换jar包,很多资料,千篇一律是要加入hive&...

spark-streaming-kafka-0-10_2.11-2.4.0-cdh6.1.1.jar

spark+cdh+hadoop,在用CDH开发过程中,可能会出现缺少依赖包的情况,这个包可能会有用!

spark-2.4.6-cdh5.16.2

import org.apache.spark.{SparkConf, SparkContext, SparkFiles} object WordCount { def main(args: Array[String]): Unit = { //scala代码实现spark入口 (这里没有指明是什么模式,在提交时指明) val conf = ...

spark2.4.6编译,基于hadoop-2.6.0-cdh5.7.0.解压可用。可使用scala2.12.0运行,用于大数据方面的个人使用或测试

推荐文章

- Ubuntu/linux下下载工具_ubuntu下载软件助手 linux版本-程序员宅基地

- HTML、JSP前端页面国际化(i18n)_html全局国际化-程序员宅基地

- Python高级-08-正则表达式_写出能够匹配只有下划线和数字还有字母组成(且第一个字符必须为字母)的163邮箱(@1-程序员宅基地

- 寻仙手游维护公告服务器停服更新,寻仙手游2月1日停服更新公告 2月1日更新了什么...-程序员宅基地

- 用python自动预约图书馆座位_微信图书馆座位秒抢脚本-程序员宅基地

- Android真机或模拟器激活Xposed框架的方法_de.robv.android.xposed.installer-程序员宅基地

- 操作系统为什么要分用户态和内核态_用户态和内核态都需要cpu参与,为什么要区分-程序员宅基地

- 01—JVM与Java体系结构(简单介绍)_01_jvm与java体系结构.pptx-程序员宅基地

- 国有建筑企业数字化转型整体解决方案_建筑企业数字化转型行动方案-程序员宅基地

- 性能测试的软件------loadrunner_loadrunner有有三个图标,-程序员宅基地