##细读论文Towards Large yet Imperceptible Adversarial Image Perturbations with Perceptual Color Distance(CVPR2020 对抗样本) 这是一篇CVPR2020中关于对抗样本的论文,作者在文中提出一种基于人类视觉感知性...

”deepfool“ 的搜索结果

以下的总结来参考论文《Threat of Adversarial Attacks on Deep Learning in Computer Vision: A Survey》 这是我看的第一篇对抗攻击类的文章,很多地方没弄懂,先根据论文粗略大概总结一下,不好的地方请指出。 1....

一、研究机器学习模型攻防的动机 我们训练的模型并非只部署在实验室,我们还需要部署到现实世界中。我们希望机器学习模型能够对专门设计来“欺骗”的输入具备一定的鲁棒性,模型光是对噪声具备一定的鲁棒性是不够的...

论文原文:Deep Neural Networks are Easily Fooled: High Confidence Predictions for Unrecognizable Images (提取码:fnrb) 简单概括下这篇文章标题要表达的意思:深度神经网络很容易受到欺骗:无法识别图像...

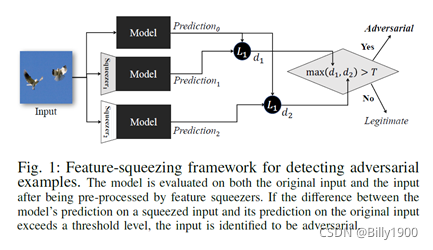

Attack and Defense 需要classifiers 不只要对噪声的抗干扰性强,还要对那些为了骗过classifier而建立的输入也有很强的抗性。 especially useful for spam classification, malware(恶意软件) detection, network ...

原文链接:https://arxiv.org/pdf/1511.06434.pdf 简介 基础结构

AnonymousNet: Natural Face De-Identification with Measurable Privacy 现有的人脸图像去识别技术要么生成图像不够真实,要么在定性和定量上无法平衡隐私和可用性。本文提出的AnonymousNet框架用以解决上述问题,...

联邦学习本身 “联邦学习” 实际上是一种加密的分布式机器学习技术,参与各方可以在不披露底层数据和底层数据的加密(混淆)形态的前提下共建模型。 如果机构之间的数据无法互通,一家企业一家机构数据量有限,或者...

文章目录简介Attack(重点)做法Loss Function for Attack约束的定义如何攻击例子小结其他方法Attack ApproachesFGSMWhite Box v.s. Black BoxBlack Box AttackUniversal Adversarial AttackAdversarial ...

Machine Learning Testing: Survey ,Landscapes and Horizons 文章目录Machine Learning Testing: Survey ,Landscapes and Horizons介绍摘要简介机器学习概论机器学习测试定义ML测试工作流测试在ML开发中的作用离线...

ACM MM 会议是多媒体领域的top1顶会 人人心向往之的会议 我的有位老师说他的学生读了三年博士,投了好几次MM都没被录,主动要求延毕,说三年我追个姑娘也追到手了,竟然投会议就是投不中。。。...

前言 本篇博客出于学习交流目的,主要是用来记录自己学习中遇到的问题和心路历程,方便之后回顾。过程中可能引用其他大牛的博客,文末会给出相应链接,侵删! 这篇博客记录大部分来自一篇Survey,文章总结了...

对抗样本攻击 ...研究背景 尽管深度学习在很多计算机视觉领域的任务上表现出色,Szegedy第一次发现了深度神经网络在图像分类领域存在有意思的弱点。他们证明尽管有很高的正确率,现代深度网络是非常容易受到对抗样本的...

DeepInspect: A Black-box Trojan Detection and Mitigation Framework for Deep Neural Networks Abstract 在部署模型之前检查预训练好的模型是否被注入后门是必要的。我们本文的目标是强调未知DNN应对神经木马...

1 前言DeepRobust是基于PyTorch对抗性学习库,旨在建立一个全面且易于使用的平台来促进这一研究领域的发展。目前在图像域中包含10多种攻击算法和8种防御算法,图域中的9种攻击算法和4种防御算法。...

对抗样本学习报告 Ⅰ.背景 随着深度学习的快速发展,在众多机器学习领域取得了重大进步,深度学习在许多至关重要的安全环境中得到应用。但,最近几年研究者发现,输入一些精心设计的样本时,深度学习表现出极大的...

前言 进入研究生阶段的学习已经一年多了,在此期间阅读了不少论文,也大都有做下一些笔记。然而,出于自己的惰性,一直没有系统的将它们整理归纳起来。因此,从今天开始希望以每天一篇论文讲解的形式将自己过往阅读...

AdvGAN ++(翻译)

标签: 深度学习

摘要 对抗性例子是虚构的例子,与原始图像没有区别,它们误导了神经网络并大大降低了它们的性能。 最近提出的AdvGAN是一种基于GAN的方法,它以输入图像为先验来生成以模型为目标的对手。 在这项工作中,我们通过提出...

文章目录一、论文相关信息 1.论文题目 2.论文时间 3.论文文献二、论文背景及简介三、论文内容总结四、论文主要内容1、介绍2、方法2.1 该论文所使用的模型2.2 用进化算法生成图片3、结果3.1 进化出不规则的...

ICCV2017论文摘要汇总

标签: ICCV

1. Globally-Optimal Inlier Set Maximisation for Simultaneous Camera Pose and Feature Correspondence Abstract: Estimating the 6-DoF pose of a camera from a single image relative to a pre-computed 3D p...

The major advancements in Deep Learning in 2016 PabloTue, Dec 6, 2016inMACHINE LEARNING DEEP LEARNING GAN Deep Learninghas been the core topic in the Machine Learning community...

推荐文章

- 记录CentOS7 Linux下安装MySQL8_适合正式环境_干货满满(超详细,默认开启了开机自启动,设置表名忽略大小写,提供详细配置,创建非root专属远程连接用户)_centos7安装mysql8-程序员宅基地

- python 读取grib \grib2-程序员宅基地

- Kimi Chat,不仅仅是聊天!深度剖析Kimi Chat 5大使用场景!-程序员宅基地

- Datawhale-集成学习-学习笔记Day4-Adaboost-程序员宅基地

- TexStudio配置以及解决无法Build&View_texstudio 无法启动 build & view:pdflatex:"d:/data/texl-程序员宅基地

- 用户空间访问I2C设备驱动-程序员宅基地

- 人脸识别算法初次了解-程序员宅基地

- maven的pom文件学习-程序员宅基地

- wamp mysql 没有启动,WAMP中mysql服务突然无法启动 解决方法-程序员宅基地

- 《树莓派Python编程入门与实战(第2版)》——3.7 创建Python脚本-程序员宅基地