本文的目的介绍损失函数,以及它们的基本原理。

”loss“ 的搜索结果

深度学习之损失函数的介绍

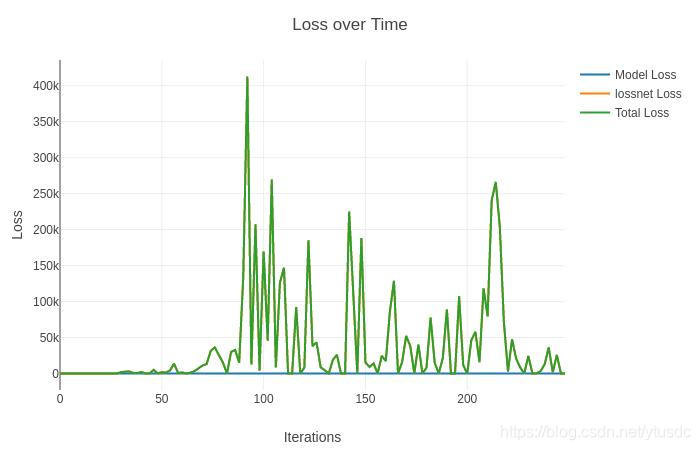

主要介绍了如何通过python画loss曲线的方法,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧

损失函数loss大全

loss曲线是指训练神经网络时,损失函数(loss function)在每个训练批次(batch)或每个训练周期(epoch)的取值变化情况。通常来说,随着模型的训练,损失函数的取值会逐渐减小,表示模型在训练数据上的拟合效果...

数据集说明 训练集是用于模型的训练的样本集合,确定模型的权重参数。 训练集的数量随着模型的复杂度要增多。 反向传播确定最优参数。 ...验证集用于验证模型的评估、模型的选择、参数的调整。...选择模型、调整超参、...

1.loss为nan 深度模型进行训练的时候,经常出现loss为nan的情况。比如某一次训练过程的输出如下: Epoch 1/50 1/303 [..............................] - ETA: 0s - loss: 278.5685 - accuracy: 0.0000e+00 47/303...

1.20.1.L1Loss(L1范数损失) 1.20.2.MSELoss(均方误差损失) 1.20.3.CrossEntropyLoss (交叉熵损失) 1.20.4.CTCLoss(连接时序分类损失) 1.20.5.NLLLoss(负对数似然损失) 1.20.6.PoissonNLLLoss (目标泊松...

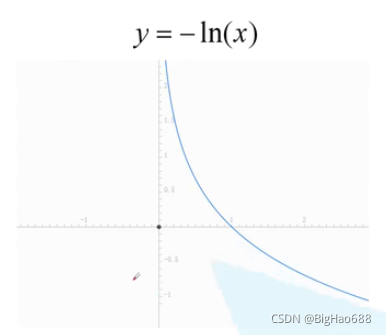

NLLLoss 负对数似然损失函数,用于处理多分类问题,输入是对数化的概率值。 对于包含NNN个样本的batch数据 D(x,y)D(x, y)D(x,y),xxx 是神经网络的输出,并进行归一化和对数化处理。yyy是样本对应的类别标签,每个...

L1Loss 平均绝对误差(MAE),用于回归模型 对于包含NNN个样本的batch数据 D(x,y)D(x, y)D(x,y),losslossloss计算如下: loss=1N∑n=1Nlnloss=\frac{1}{N} \sum_{n=1}^{N} l_{n}loss=N1∑n=1Nln 其中,ln=∣xn...

此篇文章会带你快速了解lossfunction(损失函数),用简单的语言,方便理解!!!!!

Triplet Loss的动机 一个好的特征提取器,应该尽可能的做到同类别样本映射出来的特征会聚集在一起,而不同类别的样本映射出来的特征应该要相互远离。 为了达到这个目标,Triplet Loss显式的在Loss里面要求:不同类别...

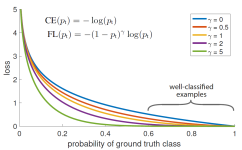

FocalLoss原理通俗解释及其二分类和多分类场景下的原理与实现

pytorch损失函数总结 损失函数为为计算预测值与真实值之间差异的函数,损失函数越小,预测值与真实...L1 Loss即绝对值损失,为预测值和真实值间误差的绝对值。 L1(x,y)=1N∑i=1n∣xi−yi∣ L1(x, y) = \frac{1}{N} \su

推荐文章

- confluence搭建部署_ata confluence-程序员宅基地

- SpringCloud与SpringBoot版本对应关系_springboot 2.1.1 对于的cloud-程序员宅基地

- 如何恢复硬盘数据?简单解决问题_磁盘恢复 csdn-程序员宅基地

- 苹果手机测试网络速度的软件,App Store 上的“网速测试大师-测网速首选”-程序员宅基地

- 教了一年少儿编程,说说感想和体验-程序员宅基地

- 22东华大学计算机专硕854考研上岸实录-程序员宅基地

- 如何用《玉树芝兰》入门数据科学?-程序员宅基地

- macOS使用brew包管理器_brew清理缓存-程序员宅基地

- 【echarts没有刷新】用按钮切换echarts图表的时候,该消失的图表还在,加个key属性就解决了_echarts 怎么加key值-程序员宅基地

- 常用机器学习的模型和算法_常见机器学习模型算法整理和对应超参数表格整理-程序员宅基地