”pack_padded_sequence“ 的搜索结果

参考视频。

019pack_padded_sequence用法与完整示例

使用的主要好处是。因为通过跳过填充部分,RNN不需要在这些部分进行无用的计算。这特别对于处理长度差异很大的批量序列时很有帮助。

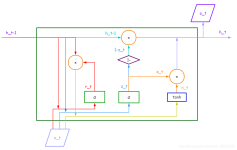

对一个已打包的序列进行解包,这个打包的序列通常是通过。设置为False,输入序列将无条件地被排序。,序列应该按长度降序排列。函数从一个填充的序列得到的。还是之前的packed。

是 PyTorch 中用于处理变长序列数据的函数。它的主要作用是将一个批次的序列数据打包成适合输入到 RNN(循环神经网络)模型中的形式,以避免对填充部分进行多余的计算。在自然语言处理任务中,例如文本分类、机器...

数据仓库架构:数据仓库架构体系。

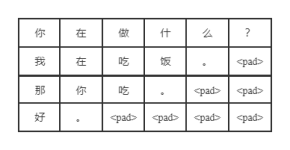

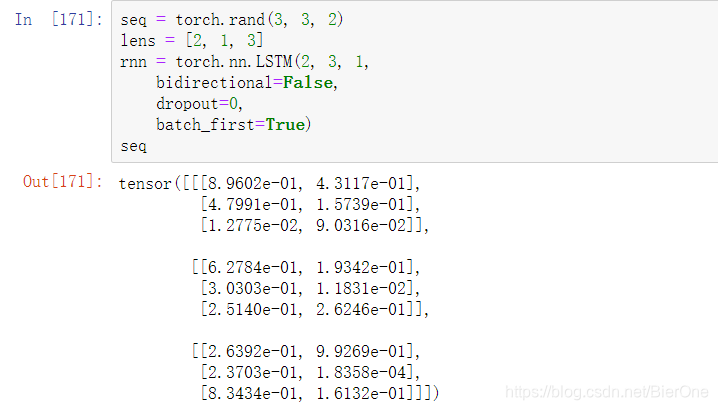

一、问题背景 在NLP的相关任务中,我们使用RNN或LSTM处理文本序列时,通常来说句子的长度是... 因此,为了解决这样的问题,在将序列送给 RNN 进行处理之前,需要采用 nn.utils.rnn.pack_padded_sequence 进行压

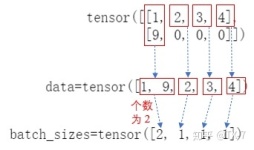

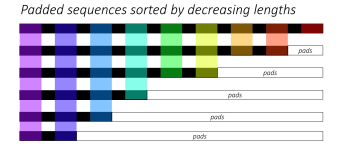

这个函数主要做了两件事: pad 和封装,因为在rnn模型中,一般先将batch中的数据按照一个...需要注意的是,默认条件下,我们必须把输入数据按照序列长度从大到小排列后才能送入 pack_padded_sequence ,否则会报错。.

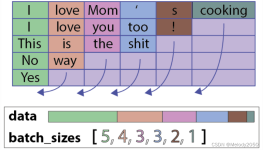

问题 当我们进行batch个训练数据一起计算的时候,我们会遇到多个训练样例长度不同的情况,这样我们就会很自然的进行padding...主要是用函数torch.nn.utils.rnn.pack_padded_sequence()和torch.nn.utils.rnn.pad_packed

但是填充后虽然长度相同,但是会有很多无效的填充值,会浪费计算资源为了使 RNN 可以高效的读取数据进行训练,就需要在 pad 之后再使用 pack_padded_sequence 对数据进行处理; input:pad后的序列(由大到小排好序...

此文章为阐述pytorch中pack_padded_sequence 和pad_packed_sequence的原理 在变长序列文本中,一个batch中的各样本长度可能不一致,在使用RNN模型时,需要填充至统一长度,被填充的位置实际无意义。我们通常取最后一...

RNN之pack_padded_sequence()和pad_packed_sequence()具体使用代码完整展现

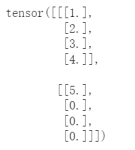

pad_sequence 填充可变长度张量列表 例子 >>> from torch.nn.utils.rnn import pad_sequence >>> a = torch.ones(25, 300) >>> b = torch.ones(22, 300) >>> c = torch....

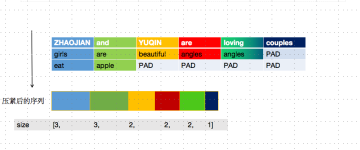

pack_padded_sequence()与pad_packed_sequence()这两个函数属于torch.nn.utils包中用来处理数据的。前者用于压紧数据,后面用于解压数据。 一. 官方+理解 1. pack_padded_sequence '官方函数' torch.nn.utils.rnn....

pack_padded_sequence 类似与一个压缩操作。 举个例子: 有一个tensor([[1,2,0], [3,0,0], [4,5,6]]),经过 pack_padded_sequence 之后会得到一个tensor([4,1,3,5,2,6]);再经过pad_packed_sequence之后会得到tensor...

pack_padded_sequence是将句子按照batch优先的原则记录每个句子的词,变化为不定长tensor,方便计算损失函数。 pad_packed_sequence是将pack_padded_sequence生成的结构转化为原先的结构,定长的tensor。 其中test....

解决RNN训练过程中batch中的文本长短不一问题。

但pad不能参与到训练,这就给广大的炼丹师带来了麻烦,但幸好Pytorch给我们提供了两个函数pack_padded_sequence与pad_packed_sequence让我们很好的解决了这个问题。 import torch from torch.nn.utils.r

pack_padded_sequence: 我们正常传进RNN模型的是一个被填充之后的序列矩阵。但是这样pad会影响模型的效果,所以要把pad删除再传进模型。 pack_padded_sequence就是起这个功能的。 pack之后,原来填充的 PAD...

torch.nn.rnn.pack_padded_sequence及pad_packed_sequence的理解pytorch官网解释理解某博主解释 pytorch官网解释理解 torch.nn.utils.rnn.pad_packed_sequence(sequence, batch_first=False, padding_value=0.0, ...

推荐文章

- 马斯克用数字孪生开启航天工业大时代,工互2.0来了吗?-程序员宅基地

- 0737-1.6.1-CDSW分布式计算_workbench分布式计算-程序员宅基地

- 动态规划算法(2)最长回文子串详解_最长回文子串动态规划-程序员宅基地

- 2010年5月12日Go生态洞察:Google I/O即将举办的Go事件-程序员宅基地

- javaWeb网上拍卖系统--秒杀与竞拍-程序员宅基地

- 我的WCF之旅(10):如何在WCF进行Exception Handling-程序员宅基地

- iOS 直播技术及Demo_ios直播懂的-程序员宅基地

- 浅谈深度学习_深度学习csdn-程序员宅基地

- _ZN10tensorflow8internal21CheckOpMessageBuilder9NewStringEv_undefined symbol: _zn10tensorflow8internal21checko-程序员宅基地

- 【深度学习】基于PyTorch搭建ResNet18、ResNet34、ResNet50、ResNet101、ResNet152网络_resnet34 resnet101-程序员宅基地