”pack_padded_sequence“ 的搜索结果

闲聊机器人之Seq2Seq模型的原理 闲聊机器人的介绍 在项目准备阶段我们知道,用户说了一句话后,会判断其意图,如果是想进行闲聊,那么就会调用闲聊模型返回结果,这是我们会在...Sequence to sequence (seq2seq)是由

本篇文章直接介绍llava模型数据加工部分,整体结构说明llava多模态模型输入数据格式,其中包含input_ids/labels/attention_mask与image格式,并给出对应代码位置与整个数据加工流程。最重要,通过debug给出数据解释...

最近在 B站 刘二大人 学习PyTorch ,上传一些学习用的代码,仅供参考和交流。

根据双向LSTM和单向LSTM的对比我们发现,正确率差距不大,但是速度缺相差较大,但理论上说双向LSTM具有比单向LSTM更多的参数,计算量更大,速度很慢,在这里却表现为速度大于单向,所以双向LSTM在有些时候是好于单向...

代码实现 Seq2Seq, Attention¶ ...在这份notebook当中,我们会(尽可能)复现Luong的attention模型 由于我们的数据集非常小,只有一万多个句子的训练数据,所以训练出来的模型效果并不好。如果大家想训练一个好一点的...

from torch.nn.utils.rnn import pack_padded_sequence # 加载ResNet-101模型并返回提取图像特征的模块 def load_resnet(): resnet = models.resnet101(pretrained=True) modules = list(resnet.children())[:-1]...

以下是一个基于注意力机制的情感分析模型的RNN代码实现。该模型使用了LSTM作为RNN的基本单元...此外,我们还使用了dropout来防止过拟合,并使用了pack_padded_sequence和pad_packed_sequence函数来处理变长的输入序列。

前言 初学torch,复现了一波官网的tutorial的聊天机器人,只不过把任务场景换成了中英翻译并且简化了一些步骤,力求做到对初学者友好,如果是初学nlp,那这个案例将是一个很好的入门...2、sequence2sequence架构的...

Seq2Seq模型的原理 目标 知道seq2seq的常见应用场景 能够说出常见的seq2seq的结构 能够使用代码完成基础的...Sequence to sequence (seq2seq)是由encoder(编码器)和decoder(解码器)两个RNN的组成的。其中encoder负

注意,本文代码来自于plm-nlp-code。 学习任何模型都需要一个简单可行的例子进行说明,我会基于plm-nlp-code的代码进行说明lstm在序列标注和句子极性二分类两个例子的应用。 序列标注参考文件lstm_postag.py. ...

本文介绍使用PyTorch的Bi-GRU模型实现sequence classification(在NLP中一般就是文本分类任务)时,对GRU输出以不同池化方式获得sequence表征,不同池化方式的写法和效果上的区别

可以使用 `torch.nn.utils.rnn.pack_padded_sequence` 和 `torch.nn.utils.rnn.pad_packed_sequence` 模块来处理变长序列输入。 以下是一个使用 PyTorch 和 CTC 实现的简单语音识别示例: ``` import torch import...

【原文链接】https://blog.csdn.net/kejizuiqianfang/article/details/100835528 ...

1. 背景介绍 随着信息爆炸时代的到来,人们每天都面临着海量文本信息。如何快速有效地获取关键信息,成为了一个亟待解决的问题。文本摘要技术应运而生,它能够将冗长的文本内容压缩成简短的摘要,方便用户快速了解...

超详细!基于pytorch的“看图说话”(Image Caption)项目实战0.简介1.运行环境1.1 我的环境1.2 建立环境2.理论介绍3.运行项目3.1 项目结构3.2 数据准备3.2 开始训练3.3 报错及解决4....0.简介 本文将介绍一个“看图...

多模态模型VSE++实现-参考《多模态深度学习技术基础》

一切皆是映射:自然语言处理(NLP)中的AI技术 1. 背景介绍 1.1 自然语言处理的重要性 在当今的数字时代,人机交互已经成为不可或缺的一部分。自然语言处理(NLP)作为人工智能的一个重要分支,旨在使计算机能够理解和生

基于rnn的名字分类器

本文为雷锋字幕组编译的技术博客,原标题 Taming LSTMs: Variable-sized mini-batches and why PyTorch is good for your health ,作者为 William Falcon 。 翻译 | 赵朋飞 马力群 涂世文 整理 | MY ...

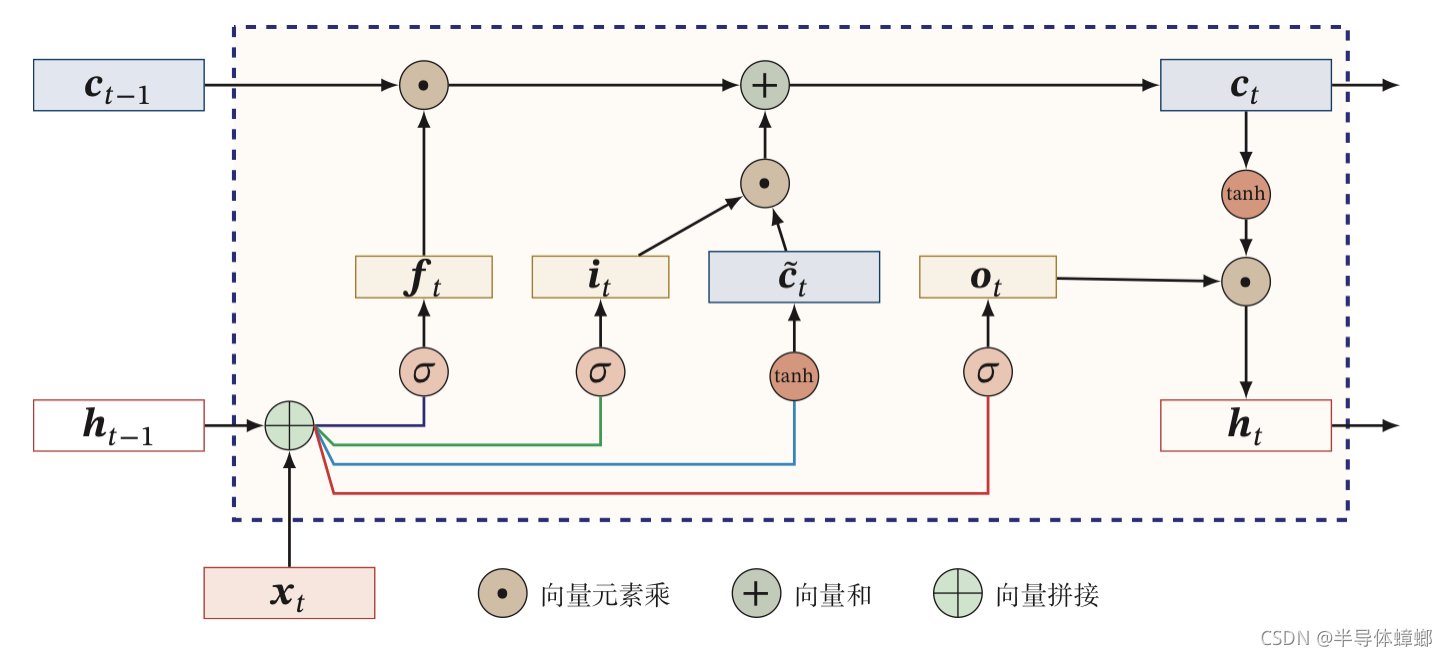

RNN、LSTM、GRU简单入门与应用举例

【代码】torch.nn中LSTM使用。

推荐文章

- Laravel随笔 Windows下Redis安装/php安装redis扩展_windows laravel 8使用 phpredis 扩展来连接 redis-程序员宅基地

- 同声传译免费软件app哪个好?让国际交流变得轻松又有趣-程序员宅基地

- 一文详解opencv摄像头数字识别_摄像头数字识别在其他场景下识别不了-程序员宅基地

- TCP三次握手四次挥手详解_tcp三次挥手四次挥手-程序员宅基地

- 域账户信息导出脚本_Facebook OAuth漏洞导致的Facebook账户劫持-程序员宅基地

- docker中容器和镜像的关系_docker镜像和容器的关系-程序员宅基地

- idea运行java报错:找不到或无法加载主类_idea找不到或无法加载java主类-程序员宅基地

- java scriptengine,使用Java ScriptEngine(Groovy),如何使它更具性能?-程序员宅基地

- docker项目运行环境搭建(JDK8、mysql8、tomcat9、redis5、nginx1.14)_docker jdk8-程序员宅基地

- 临床试验中edc录入_一文了解EDC临床试验数据采集系统-程序员宅基地