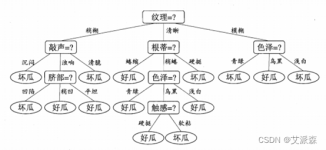

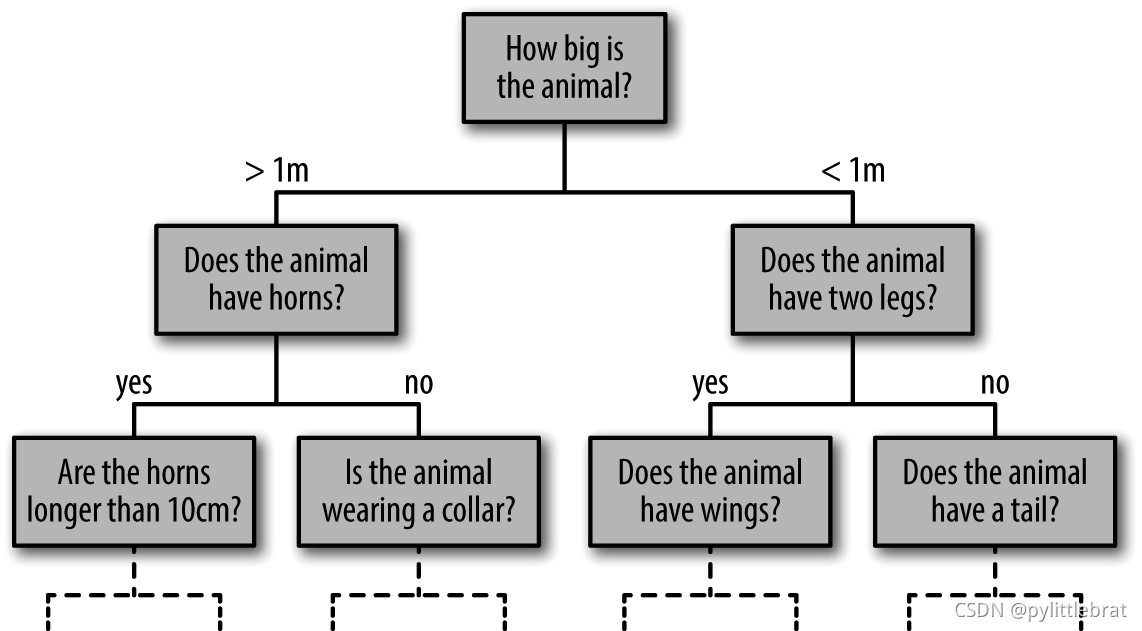

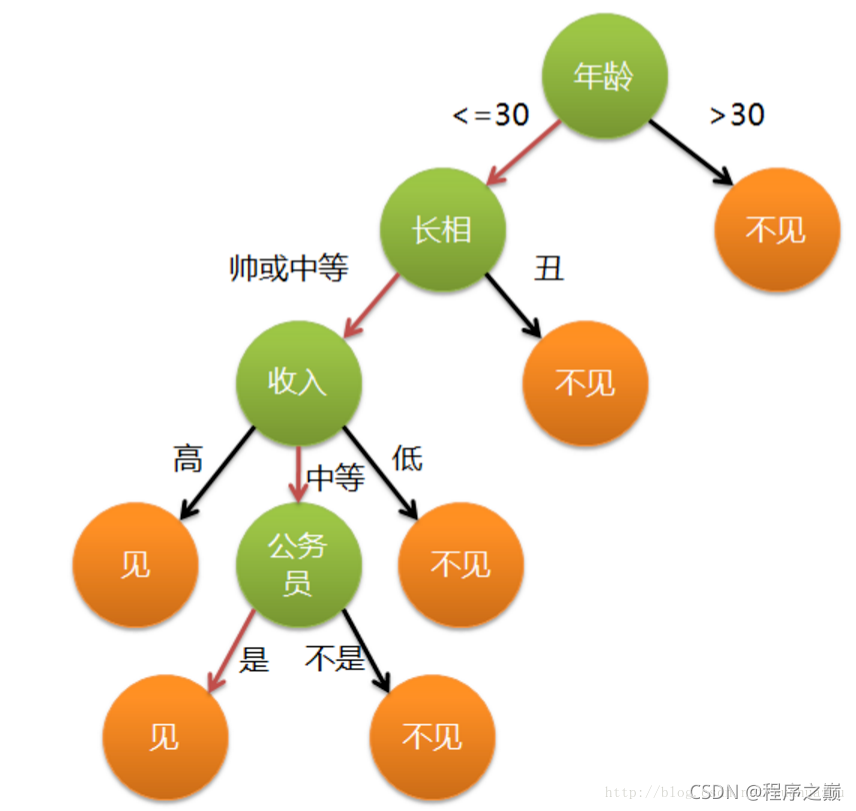

决策树的工作原理从树的根节点开始,将测试条件用于检验记录,根据测试结果选择适当的分支。沿着该分支或者到达另一个内部结点,使用新的测试条件,或者到达一个叶结点。到达叶结点以后,叶节点的类称号就被赋值给该...

”决策树“ 的搜索结果

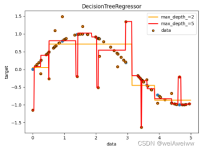

前剪枝是在决策树构建的过程中采取的措施,它可以在树的生长过程中避免不必要的分支,从而限制了复杂性。后剪枝是在完整决策树构建后进行的,通过删除不必要的分支来减小树的复杂性,通常需要计算不纯度并比较不同...

决策树算法是机器学习领域中的一种重要分类方法,它通过树状结构来进行决策分析。决策树凭借其直观易懂、易于解释的特点,在分类问题中得到了广泛的应用。本文将介绍决策树的基本原理,包括熵和信息熵的相关概念,...

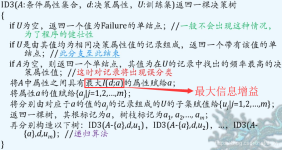

机器学习-决策树 本章介绍机器学习中一个非常重要的监督学习算法思想,决策树,决策树有很多种算法,例如CART,C4.5,ID3等,这里介绍ID3。 包括以下内容: 决策树的原理 信息,熵,信息增益的概念 如何划分...

椭圆形代表决策节点(decison nodes),矩形节点代表叶节点(leaf nodes),方向上的值代表属性的值,构建决策树的学习过程:第一步:决定在根节点上的特征(也就是第一个分开样本的特征)第二步:决定在内部节点上的...

优点:简单的理解和解释,树有可视化缺点:决策树学习者可以创建不能很好地推广数据的过于复杂的树,这被称为过拟合改进:减枝cart算法(决策树API当中已经实现,随机森林参数调优有相关介绍)随机森林注:企业重要...

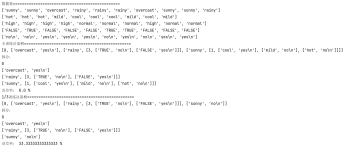

然后,对于特征 (A) 的每个取值 (v),计算子集 (X_v) 的信息熵 (H(X_v)),并根据子集的大小进行加权求和;其中,(X) 是一个离散随机变量,(n) 是 (X) 的取值个数,(p(x_i)) 是 (X) 取值为 (x_i) 的概率。...

表示所有不相同情况的乘积(如果是A、B两种情况则p(A)*p(B),如果是A、B、C三种情况则p(A)*p(B)+p(A)*p©+p(B)*p©)经计算,可见A1(湿度)的IG(信息增益)更大一些,也就意味着我们获得了更多的信息(减少的熵更多...

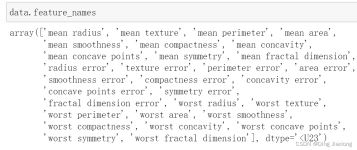

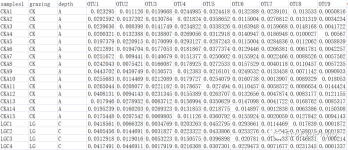

决策树的一个实验,包括数据的预处理和决策树的可视化。pr曲线和AUC的计算。

前面简单梳理的基本的决策树算法,那么如何更好的使用这个基础算法模型去优化我们的结果是本节要探索的主要内容。梯度提升决策树(Gradient Boosting Decision Trees)是一种集成学习方法,通常用于解决回归和分类...

决策树(Decision Tree)是在已知各种情况发生概率的基础上,通过构成决策树来求取净现值的期望值大于等于零的概率,评价项目风险,判断其可行性的决策分析方法,是直观运用概率分析的一种图解法。由于这种决策分支画...

推荐文章

- 【Java进阶】线程池之无限队列 - 使用工厂类Executors.newFixedThreadPool(n) ,创建无限队列线程池_线程池无限队列-程序员宅基地

- python 之路,致那些年,我们依然没搞明白的编码-程序员宅基地

- 国二报C语言,国二C语言.doc-程序员宅基地

- FTP快速搭建-程序员宅基地

- [原创]我的WCF之旅(7):面向服务架构(SOA)和面向对象编程(OOP)的结合——如何实现Service Contract的继承_servicecontract using-程序员宅基地

- openmediavault(OMV) (18)云相册(2)photoprism-程序员宅基地

- VS2017使用protobuf动态链接库的编译错误问题_vs2017运行不了protobuf项目-程序员宅基地

- idea右键项目没有出现git选项、idea工具栏没有Git快捷图标_idea 右键没有git-程序员宅基地

- m3u8索引文件介绍_69嗉媂x.m3u8-程序员宅基地

- 2021 泰迪杯 A 题_第十二届泰迪杯数据挖掘竞赛a题论文-程序员宅基地