”图注意力机制“ 的搜索结果

[1]【GNN】GAT:Attention 在 GNN 中的应用...[2]图注意力网络(GAT) ICLR2018, Graph Attention Network论文详解 [3]https://github.com/dmlc/dgl/tree/master/examples/pytorch/gat [4]https://github.com/PetarV-/GAT

Attention机制详解以及在图神经网络中的应用注意力机制和transformer框架注意力机制的来源和引入原因1.2 注意力系数的计算1.3 Transformer框架2 图注意力网络(GAT)和attention计算2.1 输入输出2.2 共享线性变化2.3...

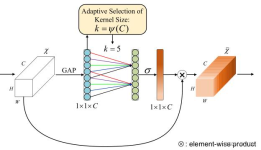

SE注意力机制(Squeeze-and-Excitation Networks)在通道维度增加注意力机制,关键操作是squeeze和excitation。通过自动学习的方式,使用另外一个新的神经网络获取到特征图的每个通道的重要程度,然后用这个重要程度...

图注意力神经网络基本原理和实现 1、 图神经网络(GNN)综述 1.1、图结构 图是计算机中的一种数据结构,图的基本构成单元是顶点 和边。一个图是由多个顶点和多条边所构成的,对于图中的任意两个顶点,如果两个点之间的...

作为一种代表性的图卷积网络,Graph Attention Network (GAT) 引入了注意力机制来实现更好的邻居聚合。通过学习邻居的权重,GAT 可以实现对邻居的加权聚合。因此,GAT 不仅对于噪音邻居较为鲁棒,注意力机制也赋予了...

基于图注意力机制和Transformer的异常检测.docx

一文带你读懂注意力机制、自注意力机制、多头注意力机制、通道注意力机制、空间注意力机制,超详细的讲解,小白也能看得懂!

图像注意力机制图解ppt

标签: 图像 注意力机制

图像注意力机制图解ppt

资源内容:基于tensorflow2-图像注意力机制实现各种图像注意力模块的Python仿真(完整源码+数据).rar 代码特点:参数化编程、参数可方便更改、代码编程思路清晰、注释明细。 适用对象:工科生、数学专业、算法等...

(上图应该省略了一个归一化层,模型通过标签知道应该(x1,y1)对应的值是最大的,就会学习到这样一个概率分布,这里直接将attention的weight作为output的distribution) 把(x1,y1)丢进去产生新的z1,继而产生新的...

为什么需要视觉注意力计算机视觉(computervision)中的注意力机制(attention)的基本思想就是想让系统学会注意力——能够忽略无关信息而关注重点信息。为什么要忽略无关信息呢?注意力分类与基本概念神经网络中的...

针对遥感图像目标密集、尺度不一、存在遮挡等特点,提出一种基于注意力机制的遥感图像分割模型用于目标分割。该模型建立在深度图像分割模型的基础上,提出在高低层特征融合之前采用通道注意力机制对低层特征进行加权...

注意力是一种在广泛的神经结构中使用的越来越流行的机制。由于这一领域的快速发展,仍然缺乏对注意力的系统...在本文中,讨论了以往工作的不同方面,注意力机制的可能用途,并描述了该领域的主要研究工作和公开挑战。

基于结合注意力机制和膨胀卷积的HRNet遥感图像语义分割python源码.zip基于结合注意力机制和膨胀卷积的HRNet遥感图像语义分割python源码.zip基于结合注意力机制和膨胀卷积的HRNet遥感图像语义分割python源码.zip基于...

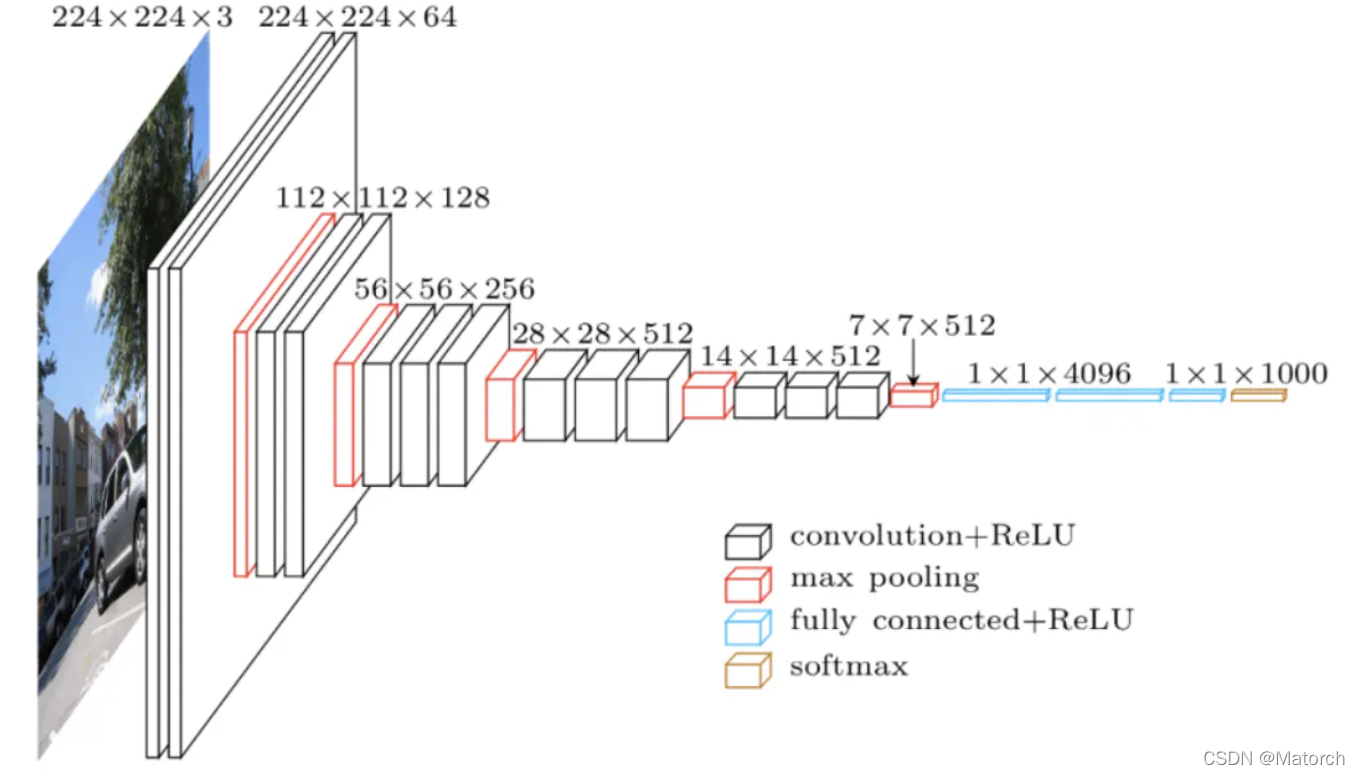

大家好,我是微学AI,今天给大家介绍一下深度学习技巧应用26-CNN中多种注意力机制的嵌入方法,终于搞懂注意力机制了。CNN是一种能够有效处理图像和其他二维数据的深度学习模型。在传统的CNN中,每个卷积核都会对输入...

通过加入空间注意力机制进行单幅图像的去雨,去雾操作

通俗易懂理解通道注意力机制(CAM)与空间注意力机制(SAM)

【图-注意力笔记,篇章1】Graph Transformer:包括Graph Transformer 的了解与回顾且其与GNN、Transformer的关联 【图-注意力笔记,篇章2】Graphormer 和 GraphFormers论文笔记之两篇经典Graph Transformer来入门 ...

这篇文章整理有关注意力机制(Attention Mechanism )的知识,主要涉及以下几点内容: 1、注意力机制是为了解决什么问题而提出来的? 2、软性注意力机制的数学原理; 3、软性注意力机制、Encoder-Decoder...

文本生成图像注意力机制

标签: 深度学习

注意力机制+ResNet的分类网络-python,Keras实现

推荐文章

- Android RIL框架分析-程序员宅基地

- Python编程基础:第六节 math包的基础使用Math Functions_ps math function-程序员宅基地

- canal异常 Could not find first log file name in binary log index file_canal could not find first log file name in binary-程序员宅基地

- 【练习】生成10个1到20之间的不重复的随机数并降序输出-程序员宅基地

- linux系统扩展名大全,Linux系统文件扩展名学习-程序员宅基地

- WPF TabControl 滚动选项卡_wpf 使用tabcontrol如何给切换的页面增加滚动条-程序员宅基地

- Apache Jmeter常用插件下载及安装及软硬件性能指标_jmeter插件下载-程序员宅基地

- SpringBoot 2.X整合Mybatis_springboot2.1.5整合mybatis不需要配置mapper-locations-程序员宅基地

- ios刷android8.0,颤抖吧 iOS, Android 8.0正式发布!-程序员宅基地

- 【halcon】C# halcon 内存暴增_halcon 读二维码占内存-程序员宅基地